Intelの次世代Panther Lakeプラットフォームは発売間近に迫っており、開発者たちは、特に各アーキテクチャのイネーブルメント作業を加速し始めている。

IntelのPanther Lake SoCは、特にAI指向のワークロードで性能が大幅に飛躍する

業界がPanther Lakeに大きな期待を寄せているのは、IntelのCPU事業が縮小している時期に登場するからだけでなく、PTLがIntel初の自社製18Aプロセスノードを採用したチップになるためであり、IFSの命運を左右することにもなる。

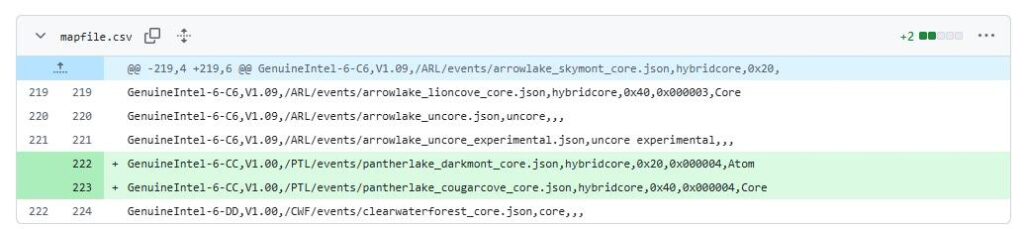

現在、@InstLatX64によって発見された新しいPCI IDリストによると、Panther LakeはCougar Cove PコアとDarkmont Eコアを搭載することが明らかになっており、この構成は控えめに言っても、Intelがモバイル・セグメントで競争力のあるポジションに立つことになりそうだ。

当初、Darkmont Eコア・アーキテクチャは、Intelの18Aで構築されるClearwater Forest Xeon CPUでデビューし、Panther LakeはEコアにSkymontを搭載すると言われていたが、現在は計画が変更されているようだ。

Panther LakeとそのSKUに関する具体的な詳細は今のところ限られているが、Xe3 「Celestial 」グラフィックス・アーキテクチャを採用することが分かっており、興味深いことに、我々は以前のリークでいくつかのSKUがどのようなものになるかについての情報を得た。

- PTL-H SKU #1: 4 Pコア + 8 Eコア + 0 LP-Eコア + 4 Xe3コア(45W)

- PTL-H SKU #2:4個のPコア+8個のEコア+4個のLP-Eコア+12個のXe3コア(25W)

- PTL-H SKU #3: 4 Pコア + 8 Eコア + 4 LP-Eコア + 4 Xe3コア (25W)

- PTL-U SKU #1: 4 Pコア + 0 Eコア + 4 LP-Eコア + 4 Xe3コア (15W)

電力定格に関しては、Panther Lakeは最大PL2定格80W(PL1 45W)、64W(PL1 28W)、54W(PL1 15W)と謳われている。

興味深いことに、PTLはNPUと呼ばれる第5世代のIntel専用AIエンジンも搭載し、SoCに最大180TOPSのAIパワーを装備すると報告されており、これはLunar Lakeの時と比べて大きな飛躍である。

Panther Lake-H CPUは、メモリ・サポートとしてLPDDR5X 6800/7467/8533 MT/sスピードとDDR5 6400/7200 MT/sスピードをサポートする。

PTLのSKUをざっとまとめてみた。リリース時期については、2025年後半をターゲットにしており、量産は2026年になると思われる。

Panther Lakeはすでにパートナーとの間でサンプル出荷が始まっており、このラインアップが市場に出回るのはそう先のことではないだろう。

Intel Panther LakeのCPU構成(出典:@Jaykihn):

| ダイSKU | Pコア (Cougar Cove) | Eコア (Darkmont) | LP-E コア (Skymont?) | Xe3 GPU コア (Celestial) | PL1 TDP | PL2 TDP |

| Panther Lake-H | 4 | 8 | 4 | 12 | 25W | 45W |

| Panther Lake-H | 4 | 8 | 4 | 4 | 25W | 45W |

| 4 | 8 | 0 | 4 | 25W | 45W | |

| Panther Lake-U | 4 | 0 | 4 | 4 | 15W | 28-30W? |

解説:

Panther Lake SoCは順調に仕上がっているようです。

Intel18Aは順調のようですが、なぜTSMCと協業するのでしょうか?

明確な答えをお持ちのIntel関係者様、よろしければぜひわたくしのx.comのアカウントに教えていただきたいです。

さて、PantherLakeはコアを一新して、NPUも変更になるようです。

AIワークロードに特に効果を発揮するということのようです。

今は猫も杓子もAIですから、これは仕方ないのかもしれませんが、決してNPUやAI性能を売りにすることはないようにした方が個人的には良いと思います。

これは、Intelだけでなく、AMDも同様です。

答えは前にも書きましたが、

| モデルサイズ | FP16 | FP8 | INT4 |

|---|---|---|---|

| 8B | 16GB | 8GB | 4GB |

| 70B | 140GB | 70GB | 35GB |

| 405B | 810GB | 405GB | 203GB |

上はローカルLLMのパラメーター数毎容量です。

最近はAirLLMというデータを分割してロードする仕組みが開発されて、容量の少ないGPUでもパラメーター数の多いローカルLLMが実行できるようですが、それでも405Bで10Tokenで応答に10-20分程度かかるようです。

これでは実用性は皆無でしょう。

- 8BでGPT3.5-Turbo程度

- 70Bで頭がよくなったとされる最新のデータセットでGPT4程度

- 405BでGPT-4o、Claude 3.5 Sonnetをやや超える程度の性能

とされています。

ここでクラウドLLMを使っている方に質問です。

今更GPT3.5-Turboに戻れますか?ということです。

ローカルLLMはdGPUを使って実行した結果であり、NPUの演算性能では7B程度でも実行は困難かもしれません。

つまり何が言いたいかというとAI PCは空っぽの洞窟です。

マーケティング上、必要なら実装せざるを得ませんが、AIを売りにするならば、ChatGPTなどの1年無料パスなどをつけて格安のChromebookをAI PCにでっち上げた方がマシです。

それほどLLMはクラウドとローカルで性能差があります。

CPUに内臓されるちっぽけなNPUで処理できるものではないです。

スマホのNPUはカメラで撮った画像をいい感じに加工してくれるカメラ機能の一部として受け入れられているのであって、AIが受け入れられているわけではありません。

3日くらい風呂に入らないでぶっ続けでゲームするような臭いゲームオタクにはインスタ映えなど必要ないですから、NPUなど不要です。

むしろ、スタバやオープンカフェで出来る人を装ってインスタ映えも気にする中途半端なリア充にこそ必要でしょう。

こういう人たちはdGPUなど買いませんので、Macbook airにガワだけそっくりなCoolに仕立てたチープなChromebookにクラウドLLMの無料パス1年分をつけて格安で売った方が売れます。

Copilot+の第一弾は大失敗しました。

これを受けて、予言しておきます。AI PCは大失敗します。

なぜなら、PCにはカメラ機能などありませんし、あってもPCをかざして写真を撮るなどナンセンスです。

NPUで頭の良いローカルLLMなど実行できませんし、万が一そういうLLMが出たとしても知名度、実用性でChatGPTには敵いません。

そこにはAIなど必要ありません。

普通の人はメジャーなものが好きです。

Llama 3.1 の405Bが凄いといっても理解してくれません。

普通の人の心に響かなければ、数は売れません。

LunarLakeは売れなかったと言われてていますが、LunarLakeが悪かったのではなく、AI PCは誰も望んでいないから売れなかったと言っておきます。

Arrow Lake-Sはゲーム性能をおろそかにしたので売れませんでした。

PantherLakeも売りたかったらAI機能などアピールせず、普通にゲームで高性能を出せますという点を前面に押し出しましょう。

もちろんX3Dよりも優れたゲーム性能は必要ですが、それさえできればゲーミングCPUとして売った方が絶対に売れます。

「今はAIだ」という営業担当の言葉に耳を傾けてはいけません。

ついていったら自殺するネズミのごとく間違いなく溺死します。

[st_af id="7981"]